Related to: Fundamentals

Transfer Learning

개요

잘 만들어진 dataset으로 잘 만든 model(pre-trained model)을 가져와 활용하는 기술입니다. 현실에서는 고품질 혹은 대량의 dataset을 얻기 힘들지만, 전이학습을 이용하면 적은 데이터로 높은 성능을 기대할 수 있습니다.

- 하나의 문제를 풀 때 얻은 지식을 관련있는 다른 문제를 풀 때 적용하는 것

- 이미 훈련된 모델을 유사 작업 수행 모델의 시작점으로 활용하는 딥러닝 접근법

핵심 개념

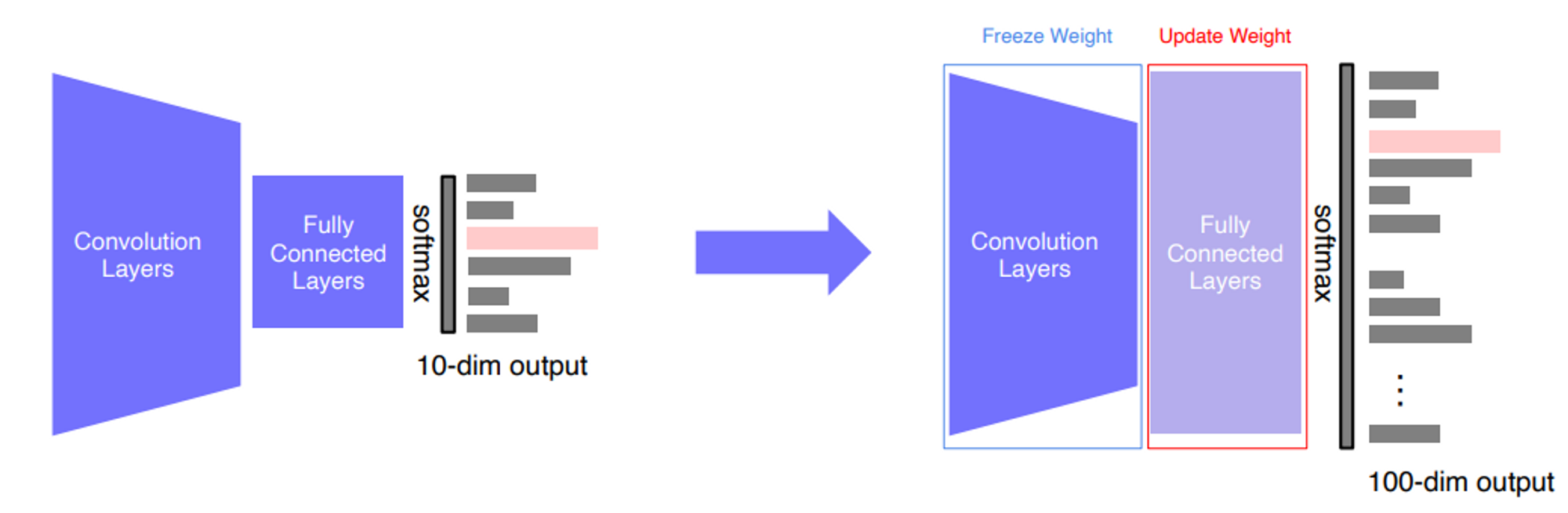

전이학습은 크게 두 가지 방식으로 활용됩니다.

- Feature Extraction: 사전학습 모델의 가중치를 고정(freeze)하고 마지막 레이어만 새 태스크에 맞게 교체하여 학습

- Fine-tuning: 사전학습 모델 전체 또는 일부 레이어의 가중치를 새 데이터로 재학습

ResNet, VGGNet, AlexNet, ViT 등의 모델들이 ImageNet 등 대규모 데이터셋으로 사전학습되어 널리 활용됩니다.

관련 개념

- ResNet - 전이학습에 가장 널리 쓰이는 사전학습 모델 중 하나

- AlexNet - 전이학습 개념을 대중화한 모델

- VGGNet - Feature Extraction에 자주 활용

- ViT - 대규모 사전학습이 필수적인 Vision Transformer

- Knowledge distillation - 모델 압축과 전이학습의 결합

- Regularization - Data Augmentation - 소량 데이터 환경에서 함께 활용

참조

https://en.wikipedia.org/wiki/Transfer_learning