Related to: Fundamentals

개요

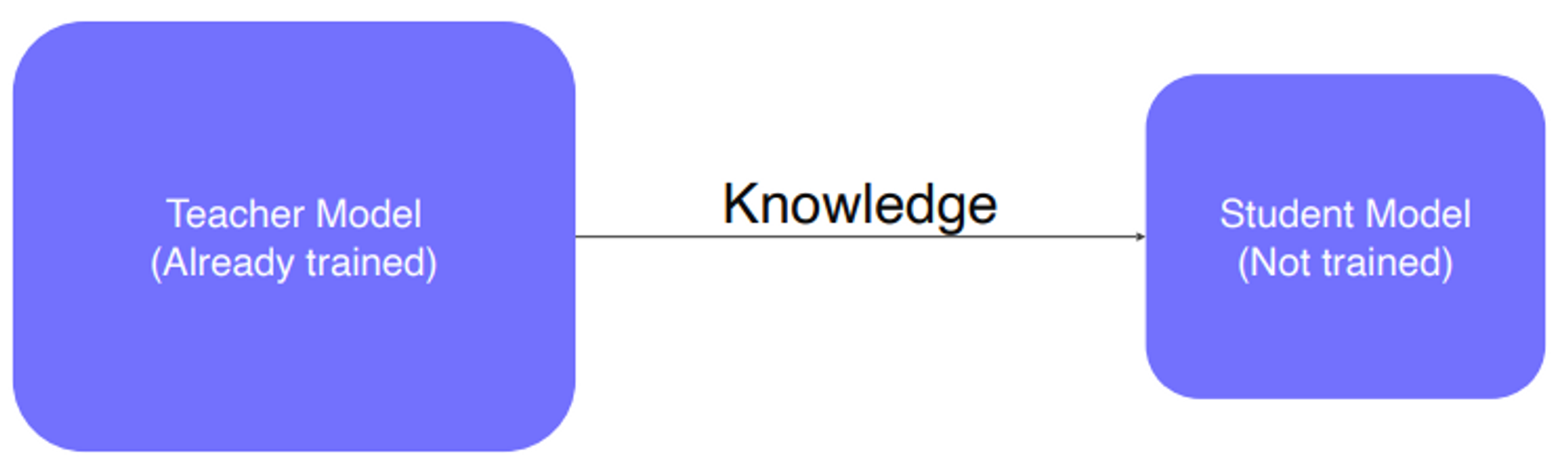

기계학습에서 Knowledge distillation은 큰 모델에서 작은 모델(일반적으로)로 지식을 이전하는 프로세스입니다. 모델 압축과 unlabeled dataset에 대한 pseudo-label(가짜 라벨) 생성에 활용됩니다.

핵심 개념

- 기계학습에서 Knowledge distillation은 큰 모델에서 작은 모델(일반적으로) 지식을 이전하는 프로세스

- 모델압축, unlabeled dataset에 대한 pseudo-label(가짜 라벨) 생성에 사용

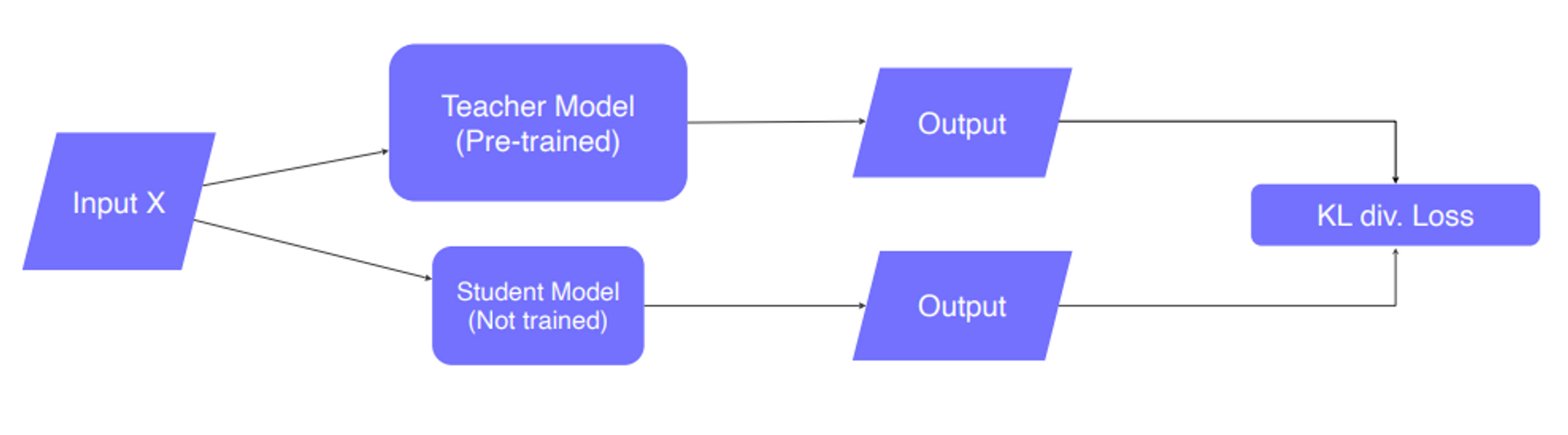

- Student Model이 Teacher Model의 결과를 흉내내게(mimic) 함

핵심 아이디어

- Teacher Model: 크고 성능이 좋은 사전 학습된 모델

- Student Model: 경량화된 작은 모델

- Teacher의 soft label(logit 분포)을 활용하여 Student를 학습

관련 개념

- Transfer Learning — 사전 학습된 모델의 지식을 활용하는 관련 접근법

- Analysis of model behaviors — 모델의 내부 표현을 분석하는 방법