Related to: Deep Learning

Optimization에서 중요한 것들

-

Generalization

- Model이 훈련에서 사용하지 않은 Data에 대해서도 성능을 발휘할수 있어야 함

-

Under-fitting vs Over-fitting

- Underfitting

- 네트워크가 특성을 나타내기 너무 간단한 경우

- 모델의 훈련이 부족한 경우

- Overfitting

- 네트워크를 너무 복잡한 경우

- 훈련을 너무 과하게 한 경우

- 데이터의 양이 충분하지 못한 경우

- Underfitting

-

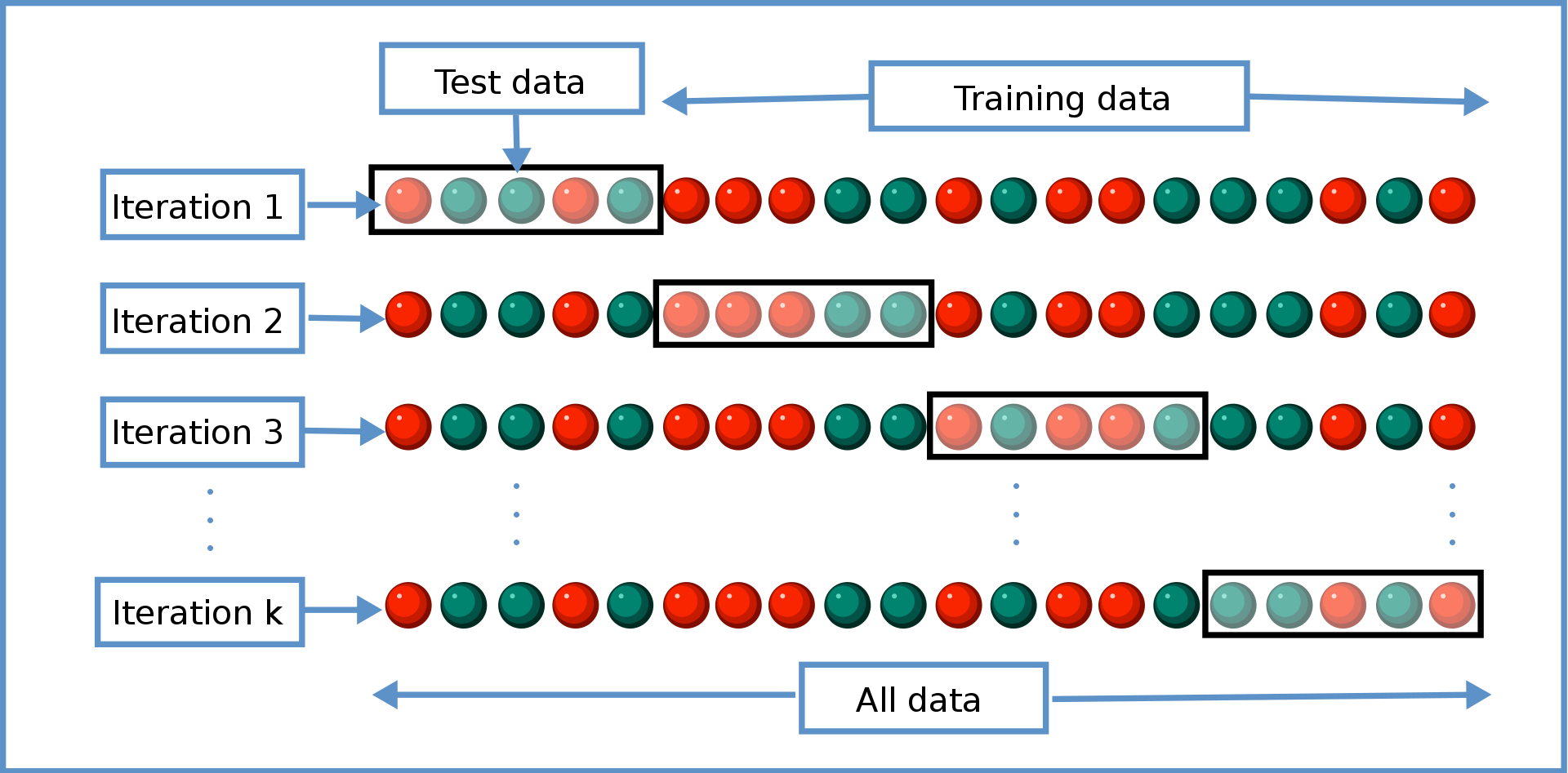

Cross validation

-

Train set을 train set과 validatin set으로 분리한 뒤, validation set을 사용해 검증하는 방식

-

Test set은 그 어떤 방식으로든 훈련에 사용해서는 안되기 때문에 위와 같이 분리

-

k-겹 교차 검증

Cross-validation (statistics) - Wikipedia

Cross-validation, sometimes called rotation estimation or out-of-sample testing, is any of various similar model validation techniques for assessing how the results of a statistical analysis will generalize to an independent data set.

https://en.wikipedia.org/wiki/Cross-validation_(statistics)#k-fold_cross-validation- 가장 일반적인 교차검증 방법

- k개의 sub sample중 하나를 validation으로 사용하고 나머지 k-1개의 sub sample은 훈련에 사용하는 방식

- 이후 교차검증을 정확히 k번 반복하여 교차검증을 수행

-

Hyper parameter를 찾기 위해 사용

-

-

Bias-variance tradeoff

- Bias : 정확도

- Variance : 정밀도

-

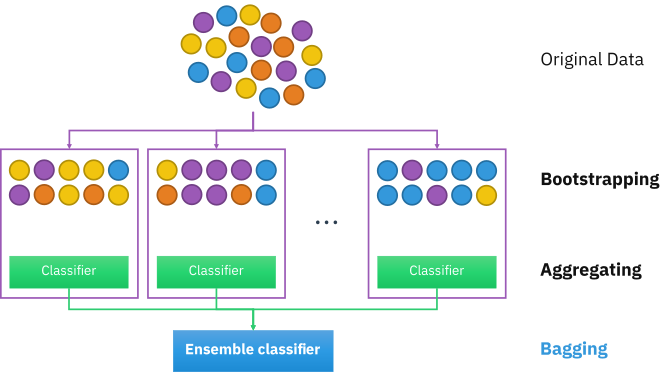

Bootstrapping(in machine learning)

- 중복을 허용하는 Random sampling을 하는 실험, 또는 metric을 의미한다

-

Bagging(Bootstrap aggregating)

- 통계적 분류 및 회귀에 사용되는 기계 학습 알고리즘의 안정성과 정확성을 개선하기 위해 설계된 앙상블 메타 알고리즘(ensemble meta-algorithm)

- 잡음이 많은 데이터 세트 내에서 분산을 줄이고 과적합을 방지

- n개의 전체 데이터 중, 복원추출(Sampling with replacement)방식으로 m개 새로운 훈련 세트를 생성

- 이러한 샘플을 Bootstrap sample이라고 부름)

- 회귀의 경우 Soft voting으로 최종 결과 값 산출

- 분류의 경우 Hard voting으로 최종 결과 값 산출

-

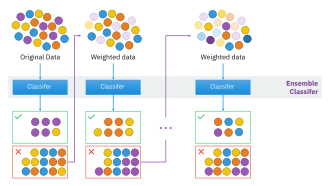

Boosting

- 지도학습의 편향과 분산을 주로 줄이기 위한 앙상블 메타 알고리즘(ensemble meta-algorithm)

- 약한 학습자 세트를 강한 학습자 세트로 결합하는 앙상블 학습 방법

- 종류

- AdaBoost(or Adaptive boosting)

- Gradient Boosting

- XGBoost(or Extreme Gradient Boosting)

참조

Bootstrapping (statistics) - Wikipedia

Bootstrapping is any test or metric that uses random sampling with replacement (e.

https://en.wikipedia.org/wiki/Bootstrapping_(statistics)

배깅 - 위키백과, 우리 모두의 백과사전

배깅(bagging)은 bootstrap aggregating의 줄임말로 통계적 분류와 회귀 분석에서 사용되는 기계 학습 알고리즘의 안정성과 정확도를 향상시키기 위해 고안된 일종의 앙상블 학습법의 메타 알고리즘이다.

https://ko.wikipedia.org/wiki/%EB%B0%B0%EA%B9%85

What is Bagging?

Learn how bootstrap aggregating, or bagging, can improve the accuracy of your machine learning models, enabling you to develop better insights.

https://www.ibm.com/cloud/learn/bagging

Boosting (machine learning) - Wikipedia

In machine learning, boosting is an ensemble meta-algorithm for primarily reducing bias, and also variance in supervised learning, and a family of machine learning algorithms that convert weak learners to strong ones.

https://en.wikipedia.org/wiki/Boosting_(machine_learning)

What is Boosting?

Learn about boosting algorithms and how they can improve the predictive power of your data mining initiatives.

https://www.ibm.com/cloud/learn/boosting