Related to: Deep Learning

AlexNet이란?

AlexNet는 Alex Krizhevsky, Geoffrey Hinton 및 Ilya Sutskever에 의해 설계된 매우 유명한 합성곱 신경망입니다.

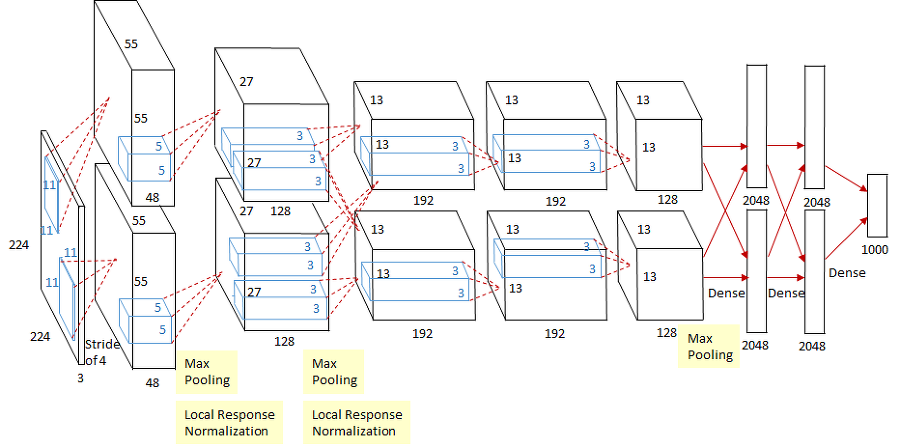

2012년 ImageNet 대규모 시각 인식 도전 과제 (ILSVRC)에 사용된 첫 번째 대규모 CNN이었습니다. AlexNet은 총 8 개의 계층으로 구성되어 있으며, 5 개의 합성곱 계층, 3 개의 완전 연결 계층 및 하나의 최종 출력 계층으로 구성됩니다.

AlexNet에서 주목할 점

AlexNet는 ReLU 활성화 함수를 사용하여 훈련 속도를 높이고 Dropout 계층을 사용하여 과적합을 줄이는 등의 여러 혁신적인 기능으로 설계되었습니다.

- Parallel Network

- GPU 연산을 고려해 두 개의 벙렬 네트워크로 구성

- ReLU(Rectified linear unit)

- LeNet-5에서 사용되었던 Tanh 함수 대신에 ReLU 함수가 사용되었습니다. 같은 정확도를 유지하면서 Tanh을 사용하는 것보다 6배나 빠르다고 하며, AlexNet 이후에는 활성화함수로 ReLU 함수를 사용하는 것이 선호되고 있습니다.

- LRN(Local Response Normalization)

- ReLU의 특성상 Conv나 Pooling 시 매우 높은 하나의 픽셀 값이 주변 픽셀에 영향을 미치게 됩니다. 이런 부분을 방지하기 위해 Activation Map의 같은 위치에 있는 픽셀끼리 Normalize을 수행합니다. 현재는 Batch Normalization을 사용합니다.

- Dropout

- Dropout은 fully-connected layer의 뉴런 중 일부를 생략하면서 학습을 진행하는 것입니다. 무작위로 몇몇 뉴런의 값을 0으로 변경합니다. 따라서 그 뉴런들은 forward pass와 back propagation에 아무런 영향을 미치지 않습니다. Dropout은 훈련시에 적용하는 기법이며, 테스트시에는 모든 뉴런을 사용합니다.

- Max Pooling

- Pooling은 컨볼루션을 통해 얻은 Feature Map의 크기를 줄이기 위해 사용하며, LeNet-5의 경우 Average Pooling을 사용한 반면, AlexNet에서는 Max Pooling을 사용했습니다.

참조

https://kr.mathworks.com/help/deeplearning/ref/alexnet.html

https://en.wikipedia.org/wiki/AlexNet

https://arxiv.org/abs/1404.5997v2

https://bskyvision.com/entry/CNN-알고리즘들-AlexNet의-구조

https://m.blog.naver.com/PostView.naver?isHttpsRedirect=true&blogId=siniphia&logNo=221376331113